Compreendendo as causas da falha humana

COMENTÁRIO:

Os

avanços no conhecimento e na tecnologia na última década, aumentaram

consideravelmente a complexidade de

sistema. Devido sua combinação singular de processos, interações tecnológica e

humana, surgem também riscos

inevitáveis, que às vezes, alguma coisa sairá errado.Este artigo faz parte de

um estudo feito por um grupo de especialistas para o Serviço Nacional de Saúde

da Inglaterra, ( National Health Service), que aborda a falha humana no

contexto geral e no serviço de saúde.

A

finalidade desse estudo é compreender a natureza da falha, sua identificação,

as barreiras para evitar sua propagação e a complexidade de sua prevenção.

INTRODUÇÃO

Este

relatório examina os fatores chaves no trabalho em falha organizacional e

aprendizagem, em uma escala de experiência prática de outros setores e o estado

atual de mecanismos de aprendizagem no NHS antes de tirar conclusões e fazer

recomendações. Suas recomendações

incluem a criação de um novo sistema nacional para relatar e analisar eventos

adversos do sistema de saúde, para certificar-se de que as lições chaves estão

identificadas e aprendidas, junto com outras medidas para apoiar trabalho no

plano local, para analisar eventos e aprender as lições, quando as coisas vão

mal.

ERRO HUMANO

Há duas maneiras de ver o erro humano:

■abordagem do elemento central

■e o sistema de abordagem

O primeiro é ainda a tradição mais dominante no âmbito da

literatura acadêmica em falha, pela maior parte porque é mais adequada para a

agenda de gerência. Esta abordagem

focaliza nos precursores psicológicos do erro, tais como;

■falta de atenção,

■esquecimento e

■falta de cuidado.

Suas

contramedidas associadas são visadas aos indivíduos em vez de situações e estas caem invariavelmente na zona de paradigma do "controle"

de gerência. Tais controles incluem as

medidas disciplinares, elaboração de mais procedimentos para guiar comportamento

individual ou responsabilizando, identificando e culpando. Com exceção do tratamento de erros, como

questões de conduta, isola atos inseguros de seu contexto, assim fazendo é

muito difícil descobrir e eliminar “armadilhas de erros” periódico no

sistema.

Embora atraente de uma perspectiva administrativa e

legal, como a abordagem predominante não é adequada ao domínio de serviço de

saúde ou em qualquer campo de alta tecnologia ou atividade de alto risco. É importante enfatizar que isto não significa

que os indivíduos nunca devem ser

responsabilizados por suas ações.

"O ERRO HUMANO DEVE SER VISTO COMO UMA CAUSA NÃO UMA CONSEQÜÊNCIA DE FALHA"

O sistema de abordagem, diferencia-se, na tomada da

posição holística nas introduções de

falha. Reconhece que muitos dos

problemas que enfrentam as organizações são complexo, não definidas e resultados

da interação de inúmeros fatores. Esta

abordagem parte da premissa que os seres humanos são falíveis e que os erros

são inevitáveis, nas melhores organizações em funcionamento (uma noção tirada

de uma publicação recente do US Institute of Medicine, Errar é humano).

Os erros são vistos como sendo formado e provocado por

fatores sistêmicos contrários, que incluem a estratégia da organização, sua

cultura e a abordagem da gerência para o risco e a incerteza. As

contramedidas associadas são baseadas na suposição que enquanto não podemos

mudar a condição humana, podemos alterar

as condições sob quais as pessoas trabalham, a fim de evitar menos erros

cometidos.

Quando um evento adverso ocorre, a questão importante

não é quem cometeu o erro mas como e porque as defesas falharam e que fatores

ajudaram a criar as condições em que os erros ocorreram. O sistema de

abordagem reconhece a importância da recuperação no interior das organizações e

também reconhece o processo de aprendizagem, como fator de tal recuperação.

"As ações

humanas são um elemento chave em muitos incidentes graves mas são somente

partes da explicação, porque o desastre

ataca"

O

erro é comumente responsabilizado por falhas porque é freqüentemente o fator

mais facilmente identificável operando

no período anterior ao evento adverso.

Contudo dois fatos importantes sobre o erro humano são freqüentemente negligenciados.

■Primeiro,

as melhores pessoas podem cometer os piores erros.

■Segundo, longe de ser aleatórios, os erros caem em

padrões periódicos. O mesmo conjunto de

circunstâncias pode provocar erros similares, independentes das pessoas

envolvidas.

Qualquer

tentativa em gerenciamento de risco, que focaliza primeiramente sobre o suposto

erro latente dos processos mentais (esquecimento,

falta de atenção, falta de cuidado, negligencia, etc) e não procura

externamente remover estas situações de

“armadilhas de erros” é certo que vai falhar.

Os erros humanos locais são os últimos e provavelmente a menor parcela

controlável da seqüência causal que conduz a algum evento adverso.

Todas

as organizações que funcionam em circunstâncias perigosas tendem a desenvolver

barreiras, defesas e proteções que intervém entre a fonte do perigo e as

vítimas potenciais ou as perdas que ocorreriam se o risco torna-se

realizado.

Estas defesas podem ser;

■ou “rígidos” (controles físicos, automação e projetos

de segurança)

■ou “leves” (procedimentos, protocolos, controles

administrativos e as pessoas' que

interagem com os problemas').

Os elementos humanos de um sistema podem enfraquecer

ou criar lacunas nestas defesas de duas maneiras:

■pelas falhas ativas e

■pelas condições ou circunstancias latentes

AS FALHAS ATIVAS

São os atos inseguros cometidos por aqueles

profissionais que interagem com os problemas.

Estas podem ser por deslizes, lapsos, erros ou violações de

procedimentos. Têm um impacto imediato e

geralmente transitórias nas camadas defensivas.

Tendem também a ocupar um “espaço” em toda a investigação subseqüente.

AS CONDIÇÕES OU

CIRCUNSTÂNCIAS LATENTES

São

comparáveis aos sintomas de doença no corpo.

Por eles, freqüentemente não

fazem nenhum dano particular. Podem

encontrar-se adormecido no sistema por longos períodos antes de combinar com os

fatores locais e as falhas ativas para penetrar ou contornar as defesas. A pesquisa sugeriu que as organizações podem

inserir as precondições para a falha, e que esta pode ocorrer muitos anos

depois.

As circunstâncias latentes aparecem das decisões

estratégicas feitas por projetistas, construtores, procedimentos escritos, e

pela alta gerência Todas essas decisões

têm um potencial para semear “doença”

no sistema, algumas boas (portanto o termo condição latente é melhor que

falha latente).

Por exemplo, a alocação de recursos limitados pela

gerencia. Mas isto, raramente é feito em uma base eqüitativa. Alguns departamentos recebem mais, outros

menos, de acordo com as ponderações

feitas naquele momento Para o último,

estes recursos são insuficientes, podem traduzir em condições propicias para erro no local de trabalho, por

exemplo, pressão de trabalho, fadiga excessiva,

falta de funcionários na equipe, a falta de experiência e o equipamento

inadequado. Ao contrário das falhas

ativas, cujos padrões precisos são difíceis de predizer, as circunstâncias

latentes estão sempre presentes.

Podem ser identificados e removidos antes que causem

um evento adverso. Para usar uma outra

analogia: os erros e as violações do

pessoal da linha de frente (pessoal que está em contato com o trabalho) são

como bombeiros que apagam apenas incêndios.

O remédio duradouro deve eliminar a origem desses incêndios Os incêndios

são as circunstâncias latentes sempre presentes. Entretanto o processo de dirigir-se a estas

circunstâncias latentes pode golpear no coração da cultura ou do paradigma

dominante dentro da teoria gerencial.Conseqüentemente, as tentativas de tratar

com tais assuntos são freqüentemente problemáticos, porque requerem mudanças

bastante fundamentais à opinião do núcleo e aos valores da equipe de

funcionários seniores da organização.

"A evidência

de um grande número de registros de acidentes indicam que os eventos

desfavoráveis são mais freqüentes no resultado de situações e de atividades

propensas a erros do que são de pessoas

propensas a erros"

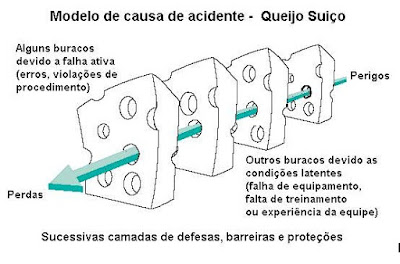

Uma visão da causa de acidente muito corrente nos

campos da aeronáutica e de usina nuclear é chamado “o modelo do queijo suíço”.

Isto é ilustrado na figura.

Figura- A quebra de

defesas é ilustrada com base na analogia do “queijo suíço”. De acordo com ela,

o acidente ocorre quando a falha mostra-se capaz de passar pela série de

barreiras defensivas existentes no sistema.

Idealmente, todas as defesas que separam perigos das

perdas potenciais devem ser intactas;

mas, na realidade, são mais como fatias do queijo suíço , cheio de

buracos. Ao contrário dos buracos do

queijo suíço, entretanto, as lacunas em sistema de defesas estão continuamente abrindo, fechando e mudando de

posição. São criados, como discutida

acima, por falhas ativas e por circunstâncias latentes. O perigo sério aumenta quando um conjunto de

linhas de buracos permite uma abertura

momentânea de oportunidade para o acidente. Nas empresas de tecnologia os sistemas

bem-defendidos (por exemplo, fábrica de aviões. usinas nucleares,), com muitas

camadas de barreiras e de proteções, tais oportunidades do acidente são raras,

mas podem ter conseqüências devastadoras.

Em muitos campos da clínica

médica, entretanto, pode haver relativamente poucas fatias protetoras intervindo entre o perigo e

o dano.

Em cirurgia, por exemplo, muito pouco se encontra

entre o bisturi e algum nervo ou vaso sanguínea, à exceção da habilidade e do treinamento do

cirurgião. No serviço de saúde, os

elementos humanos do sistema são freqüentemente as últimas e mais importantes

defesas.

No serviço de

saúde, os elementos humanos do sistema são freqüentemente as últimas e mais

importantes defesas.

Um bom exemplo da necessidade colocar o erro humano na

perspectiva é fornecido pelo desastre aéreo

de Kegworth em 1989.

ERRO HUMANO EM PERSPECTIVA – O DESASTRE AÉREO DE KEGWORTH

Em 1989, 47 pessoas morreram quando um avião Boeing

737-400, da companhia aérea britânica Midland, caiu na estrada.

A ação imediata que precipitou a queda do avião foi à

interrupção de um dos motores que estava apresentando problema devido a um incendio. Os pilotos foram criticados por agir

rapidamente e por falhas na interpretação dos instrumentos dos painéis.

O relatório oficial fez inúmeras recomendações a

respeito das mudanças no avião, bem como,

apontando às falhas dos pilotos e equipe de bordo. A mídia, contudo, usou o termo “erro humano” para descrever o

evento.

De fato o acidente em Kegworth ilustrou como a falha

de sistema pode ocorrer em vários níveis.

■No primeiro exemplo havia uma falha do componente

técnico próprio que resultou da fratura das pás da turbina. A natureza

específica desta falha não foi identificada pelo sistema de advertência do

avião que falhou em fornecer aos pilotos informações corretas (limitações dos

instrumentos) a respeito da natureza do

evento.

■Havia também uma falha no processo de tomada de

decisão dos pilotos que conduziram o seu diagnóstico incorreto da origem da

falha do motor e induziu a desligar a turbina errada. Uma série de falhas de comunicação combinou o

problema. Os pilotos reclamaram que eles

eram constantemente distraídos pela comunicação

do controle de tráfego aéreo e

isto provocou a reavaliação da decisão para desligar a turbina direita do

avião, turbina errada.

■Além disso, havia também uma falha da equipe de

bordo e dos passageiros para comunicar

suas observações de fumaça e chamas da turbina esquerda do avião.

Finalmente, havia umas séries dos fatores

organizacionais e ambientais que combinaram para criar o clima em que a falha

ocorreu. Estes incluíram

■o projeto da cabine do piloto e de sua

instrumentação,

■os protocolos disponíveis para pesquisar a falha,

■as dificuldades enfrentadas pelos pilotos na

reprogramação do computador automático de aterrissagem e

■o treinamento dado aos pilotos para permitir-lhes

adaptar a um novo tipo de aeronave .

Fonte: Smith 1999

Na NHS também, os eventos adversos são freqüentemente

o resultado de uma série dos erros ou omissões que conduzem ao evento crítico

próprio. Isto é ilustrado pela seqüência

de eventos, levando à morte em 1997 de um menino pela administração

incorreta de uma droga anticâncer. Nesta

seção fazemos o estudo do caso, especificamente, analisando os eventos subjacentes que levaram

à tragédia.

Os pesquisadores identificaram um número de fatores

gerais que influenciam o serviço clínico,

muito do quais, podem ser relacionadas aos incidentes tais como aquele

ilustrado em detalhe acima. É

facilmente aparente que os assuntos que

se relacionam diretamente ao profissional

de serviço de saúde são somente um subconjunto pequeno dos fatores no

trabalho no serviço clínico.

Fatores que influenciam a assistência de serviço de

saúde

■Contexto institucional

■Fatores organizacionais e de gerência

■Ambiente de trabalho

■Fatores de equipe

■Fatores individuais (da equipe de funcionários)

■Fatores da tarefa

■Características do paciente

Fonte:: Vincent, Taylor-Adams and Stanhope 1998

Isto não quer dizer que os indivíduos podem ser

eximidos de suas responsabilidades, nem que a ação disciplinar é nunca

apropriada – por o exemplo nos casos que envolvem atos mal intencionados ou negligencia. É preferível que o sistema de abordagem

sugere que não devemos automaticamente assumir ou procurar alguma falha

individual grave, censurável como a causa principal de um evento adverso. Um foco unicamente nas falhas individuais da equipe de funcionários não

aproveitará causas importantes de eventos adversos e impedir a aprendizagem eficaz.

Isto não quer dizer que os indivíduos podem ser

eximidos de suas responsabilidades, nem que a ação disciplinar é nunca

apropriada – por o exemplo nos casos que envolvem atos mal intencionados ou

negligências. É preferível que o

sistema de abordagem sugere que não devemos automaticamente assumir ou procurar

alguma falha individual grave, censurável como a causa principal de um evento

adverso. Um foco unicamente nas

falhas individuais da equipe de

funcionários não aproveitará causas importantes de eventos adversos e impedir a aprendizagem eficaz.

O SISTEMA DE ABORDAGEM DE GERÊNCIA DE ERRO

Pesquisa especificamente focalizada em sistemas de

serviço de saúde, sugere que cerca de

70% de incidentes adversos são evitáveis. Entretanto, os erros possam ser

minimizados, eles nunca serão

completamente eliminados, particularmente onde os volumes elevados de

atividades ocorrem. Estimou-se, por

exemplo, que um hospital com residência médica com 600 leitos, com índice de

99,9% isentos de erros de pedidos de

medicamentos, a distribuição e

controle experimentará 4.000 erros de

receitas de droga ao ano.

Assim medidas devem ser tomadas para limitar as

conseqüências adversas desses erros que

ocorrem ainda. Isto envolve, projetando ou modificando sistemas, de modo

que possam ser mais capazes para tolerar erros humanos inevitáveis e controlar

suas conseqüências prejudiciais.

Enquanto esses erros cometidos

próximos à pessoa tende alocar volume de seus recursos para tentar fazer

indivíduos menos falíveis, o sistema indica a abordagem para um programa

detalhado dirigido simultaneamente em

pessoas, equipes, tarefas, locais de trabalho e instituições. Não há única solução que pode ser aplicada em

cada circunstância.

Desde que os eventos

adversos graves têm raramente uma única causa isolada, tentativas de prevenir

ou atenuar eventos adversos necessita dirigir-se não somente a cadeia de eventos simples, mas ao sistema

como um todo. Enquanto os detalhes de alguma falha futura dificilmente podem

ser previstas, as defesas podem ser instaladas que limitarão seus efeitos

danosos.

Sistemas bem projetados podem minimizar os efeitos

prejudiciais dos erros antecipando sua ocorrência e detectando-os num estágio

inicial. Um exemplo simples é o processador de

texto. Seus projetistas compreenderam

que as pessoas podem sair dos arquivos sem salvá-los. Assim construíram lembretes e “funções

obrigatórias” tornando isto mais difícil.

Princípios semelhantes podem ser aplicados para eliminar armadilhas de erro em sistemas

perigosos, e certamente à aplicação de soluções do projeto. Um exemplo recente do serviço de saúde é o

desenvolvimento de seringa retrátil

automática, que expõe a agulha somente no momento da aplicação da injeção,

ajudando na prevenção de ferimentos de agulha.

Alta tecnologia, procedimentos de alto risco, foi pouco pesquisada para sua relevância aos

eventos adversos. Entretanto pesquisa

recente sugere que fatores particulares podem estar no trabalho neste campo, e

indica como uma área particularmente importante do serviço de saúde. As áreas de alta tecnologia tais como; UTI

(unidade de terapia intensiva), sala de emergência, sala de operação e medicina

de alto risco, tais como, oncologia, transplante, neurocirurgia, e terapia genética, compartilham de muitas

similaridades com outros sistemas sociotécnicos complexos em que as pessoas

e tecnologias complexas interagem.

É lógico concluir que as teorias de acidentes de organização ou de

sistema, tais como aquelas que discutimos neste capítulo, é aplicável aos eventos

adversos que ocorrem nestas áreas. As

ações fatais na sala de operação ou na enfermaria são freqüentemente o

resultado de um acumulo múltiplo de falhas menores e importantes, muitas das

quais podem ter suas origens longe do ambiente imediato de saúde.

Há, entretanto, uma diferença importante entre a

medicina de alto risco e sistemas sociotécnicos complexos tais como a indústria

aeronáutica . Os avanços técnicos nos

últimos tempos foram tais, que as falhas

técnicas importantes são raras comparadas às falhas humanas. Na medicina de alto risco, as falhas podem

ser atribuídas ao risco do paciente enfermo (por exemplo, se um paciente

estiver com saúde geral debilitada), o risco inerente em alguns tratamentos

difíceis e/ou desempenho deficiente dos fornecedores de saúde .

"Mesmo em

casos de falhas humanas importantes, o comportamento de compensação apropriado

pode impedir os eventos adversos"

Pesquisa recente nestas interações destacou o papel de

falhas humanas além dos riscos atribuíveis às circunstâncias particulares e aos

tratamentos particulares de alto risco.

Também mostrou que mesmo nos casos de falhas humanas importantes, o

comportamento de compensação apropriado pode prevenir eventos adversos.

O mesmo estudo

demonstrou que muito pouco é feito muito para erradicar muitas falhas pequenas,

dificilmente observadas pelos clínicos que estão atendendo. Mostraram ter um

efeito multiplicativo, de modo que se tornaram um fator de risco

significativo. Tratando com estas falhas

menores é uma das importantes mudanças de tarefas de organizações de sistema de

saúde. São tão sutis que a maioria delas

não são informadas mesmo na maioria do sistema de registro de relatório de

incidente. O emprego de especialistas de

fatores humanos como observadores exteriores para finalidades da pesquisa foi

extremamente útil em detectar estas falhas menores, mas se tais técnicas são

apropriadas ou praticáveis para uma aplicação geral como uma ferramenta de treinamento e de melhoria de qualidade

é mais questionável.

Outra pesquisa mostrou que para um procedimento de alto risco,

como uma cirurgia de artéria coronária,

o índice de complicações pós-operatório não correlacionou fortemente com os

índices de morte pós-operatório. Havia

entretanto uma correlação entre os índices de morte e sucesso em corrigir

complicações quando surgiram: o hospital

com mortalidade mais elevado teve um

índice mais elevada de falha para salvar de complicação, em vez de um índice

mais elevado de complicação própria

O que tudo isto sugere

é que uma grande extensão da medicina de alto risco é limitada para ser

evento importante e que erros e complicações sérias nunca serão erradicados,

simplesmente porque há um nível de risco para que nenhum sistema pode

inteiramente compensar. Focalizar na correção,

na recuperação ou no salvamento destas complicações e falhas, na gerência do

erro, bem como, na prevenção de erro é

uma maneira importante e sub-reconhecida para melhorar a segurança nestas

áreas.

Muitas equipes médicas e cirúrgicas, enquanto são

perfeitamente capazes de tratar com segurança os casos “diretos”, não podem ter

a capacidade de enfrentar com eventos adversos sérios. Esta é uma das principais diferenças

fundamentais entre sucesso e falha.

Fonte: An

organisation with a memory - Report of an expert group on learning from adverse events in the NHS, chaired by

the Chief Medical Officer

Obs: sociotécnico - Na realidade, o posto de trabalho

não é uma ilha, mas um sistema que faz parte de um sistema mais vasto, a que

chamamos sociotécnico, complexo e aberto, incluindo não apenas o sistema

técnico e organizacional de trabalho como a própria empresa como um todo e o

seu meio ambiente pertinente (por ex., comunidade, mercado, clientes,

fornecedores).

Marcadores: gerenciamento de riscos

0 Comments:

Postar um comentário

<< Home